“我们希望团队的好工作被更多人关注与认可,但不是以这种方式。”6月3日,对于连日来备受关注的斯坦福大学AI团队疑似抄袭面壁智能一事,面壁智能CEO李大海作出回应。同一天,面壁智能联合创始人刘知远也发文回应提到,开源共享的基石是对开源协议的遵守,对其他贡献者的信任,对前人成果的尊重和致敬,Llama3-V团队无疑严重破坏了这一点。

风波中心的Llama3-V多模态大模型出自于斯坦福大学的一个本科生团队。几天前,该团队发布这一模型,并宣称只需500美元训练,其性能就比GPT-4V、Gemini Ultra、Claude Opus更强,一度成为“HuggingFace Trending”Top5。但随后,该模型被指抄袭面壁智能发布的MiniCPM-Llama3-V 2.5,且声浪越来越大。

面壁智能是一家“清华系”人工智能大模型创业公司,成立于2022年8月,今年4月刚刚宣布完成新一轮数亿元融资。面壁智能自研了百亿参数预训练语言大模型CPM,MiniCPM是其端侧模型,也被成为“小钢炮”。

今年5月20日,面壁智能推出并开源MiniCPM系列最新的端侧多模态模型MiniCPM-Llama3-V 2.5,支持30+种语言,可实现最强端侧多模态综合性能。

对于Llama3-V套壳、抄袭MiniCPM-Llama3-V 2.5的指责,主要聚焦在Llama3-V的模型结构和配置文件与MiniCPM-Llama3-V 2.5完全相同,只是进行了一些重新格式化并将部分变量重新命名,Llama3-V具有与MiniCPM-Llama3V2.5相同的分词器,包括MiniCPM-Llama3-V 2.5新定义的特殊符号等方面。

Llama-3V团队曾回应成,他们只是使用了MiniCPM-Llama3-V 2.5的分词器,并在MiniCPM-Llama3-V2.5发布前就开始了这项工作,但并未解释如何做到在MiniCPM-Llama3-V 2.5发布之前就获取详细分词器的具体方式。

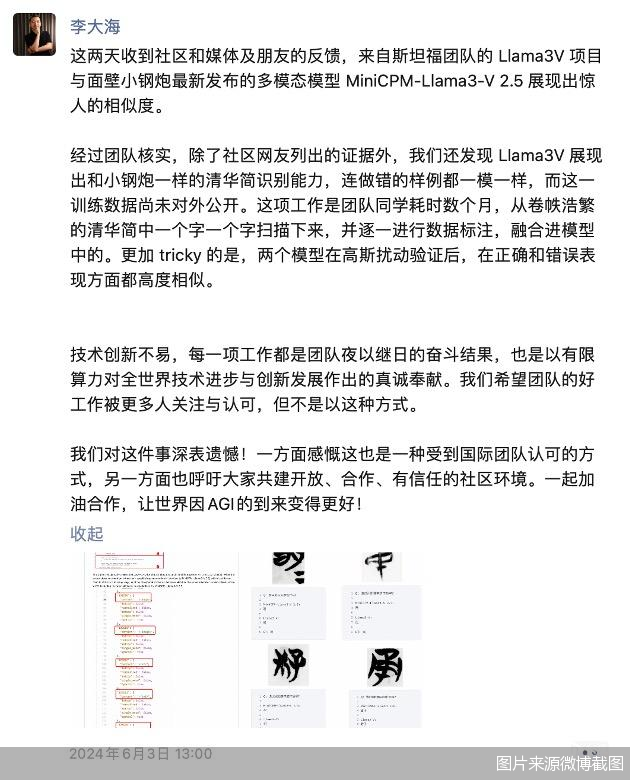

随着事件引发的关注度越来越大,李大海与刘知远先后作出回应,其中最为关键且特别的证据,在于“清华简”。李大海称,经过团队核实,除了社区网友列出的证据外,面壁智能还发现,Llama-3V展现出和小钢炮一样的清华简识别能力,连做错的样例都一模一样,而这一训练数据尚未对外公开。此外,两个模型在高斯扰动验证后,在正确和错误表现方面都高度相似。

清华简是清华大学收藏的一批战国竹简。刘知远也提到,已经比较确信Llama-3V是对MiniCPM-Llama3-V2.5的套壳,“比较有意思的证据是MiniCPM-Llama3-V 2.5研发时内置了一个彩蛋,就是对清华简的识别能力,这是我们从清华简逐字扫描并标注的数据集,并未公开。而Llama-3V展现出了一模一样的清华简识别能力,连做错的样例都一样”。

目前,Llama3-V团队的两位作者已在社交平台上就这一学术不端行为向面壁智能MiniCPM团队正式道歉,并将问题归咎于另一名“无法联系”上的成员,同时表示会将Llama3-V模型悉数撤下。斯坦福人工智能实验室主任Christopher David Manning也发文谴责这一抄袭行为,并对MiniCPM这一中国开源模型表示赞扬。

值得一提的是,Llama3-V抄袭风波引发广泛关注的另一面,也在于大模型领域开源、套壳、抄袭由来已久的争议。在接受 记者采访时,香颂资本董事沈萌称,开源就是把源代码公开,公开时都会选择一个遵循的协议,不同协议需遵循不同的规范。套壳还是抄袭的界定,都取决于开源的协议以及对方采取了怎样的动作。

记者采访时,香颂资本董事沈萌称,开源就是把源代码公开,公开时都会选择一个遵循的协议,不同协议需遵循不同的规范。套壳还是抄袭的界定,都取决于开源的协议以及对方采取了怎样的动作。

记者查阅发现,MiniCPM-Llama3-V2.5遵循Apache 2.0开源许可证。根据数据库厂商PingCAPA,Apache许可证鼓励代码共享和最终原作者的著作权,允许源代码修改和再发布,但是需要遵循以下条件,比如需要给代码的用户一份Apache Licence,如果修改了代码,需要在被修改的文件中说明,在衍生的代码中(修改和有源代码衍生的代码中)需要带有原来代码中的协议、商标、专利声明和其他原来作者规定需要包含的说明等。

记者查阅发现,MiniCPM-Llama3-V2.5遵循Apache 2.0开源许可证。根据数据库厂商PingCAPA,Apache许可证鼓励代码共享和最终原作者的著作权,允许源代码修改和再发布,但是需要遵循以下条件,比如需要给代码的用户一份Apache Licence,如果修改了代码,需要在被修改的文件中说明,在衍生的代码中(修改和有源代码衍生的代码中)需要带有原来代码中的协议、商标、专利声明和其他原来作者规定需要包含的说明等。

PingCAP举例称,在一个使用Apache许可证的开源项目中,其下游Fork的企业不仅没有回馈上游开源项目,反而将衍生的代码更改为不受OSI认可的SSPL Licence,另行宣布成为一个新的开源项目,误导了很多不明真相的人,以为又涌现出一个新的开源项目。但该行为其实已经对原开源项目的合法权益造成了侵害,也有背开源精神。

一位面壁智能高管对媒体表示投资杠杆,“可以简单理解为Llama3-V团队直接拿我们的模型改了个名字,就发布出来变成他们的成果,并且宣传是他们的独立工作”。对于后续安排等问题, 记者联系了面壁智能,截至发稿未收到回复。

记者联系了面壁智能,截至发稿未收到回复。